Vertrauen in Zeiten synthetischer Wirklichkeit

Lesezeit 3 Minuten

Ressort und Schlagwörter

Rheinland-PfalzSozialesWeitere regionale Nachrichten

Wer übernimmt im Handwerk? Chancen für eine Region

Mainzer Bildungsministerium droht eine Klagewelle

Familienzeit im Tierpark und Untertage-Labyrinth

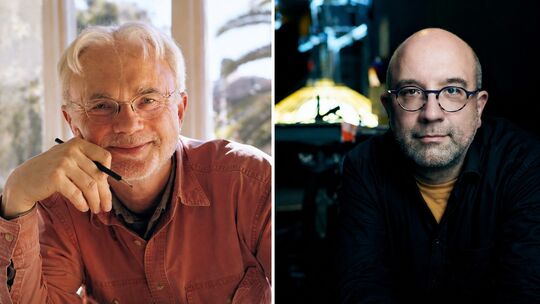

Weltpolitik als Oper

Teuber und Ebling müssen ihre Ministerien abgeben